- INTRO

- Lectures XVIIe-XVIIIe

- Lectures XIXe-XXe

- 1820-1840

- 1840-1860

- 1860-1880

- 1880-1900

- 1900-1910

- 1910-1920

- 1920-1930

- 1920s

- Breton

- Tanguy - Ernst

- Eluard

- Jacob - Cocteau

- Gramsci

- Lukacs

- Hesse

- Woolf

- Valéry

- Alain

- Mansfield

- Lawrence

- Bachelard

- Zweig

- Larbaud - Morand

- Döblin

- Musil

- Mann

- Colette

- Mauriac

- MartinDuGard

- Spengler

- Joyce

- Pabst

- S.Lewis

- Dreiser

- Pound

- Heisenberg

- TS Eliot

- Supervielle - Reverdy

- Sandburg

- Duhamel - Romains

- Giraudoux - Jouhandeau

- Svevo - Pirandello

- Harlem - Langston Hughes

- Cassirer

- Lovecraft

- Zamiatine

- W.Benjamin

- Chesterton

- 1930-1940

- 1940-1950

- 1940s

- Chandler

- Sartre

- Beauvoir

- Mounier

- Borges

- McCullers - O'Connor

- Camus

- Horkheimer - Adorno

- Cela

- Wright

- Bellows - Hopper - duBois

- Gödel - Türing

- Bogart

- Trevor

- Brecht

- Bataille - Michaux

- Merleau-Ponty - Ponge

- Simenon

- Aragon

- Algren - Irish

- Mead - Benedict - Linton

- Vogt - Asimov

- Orwell

- Montherlant

- Buzzati - Pavese

- Lewin - Mayo - Maslow

- Fallada

- Malaparte

- Bloch

- Canetti

- Lowry - Bowles

- Koestler

- Boulgakov

- 1950-1960

- 1950s

- Moravia

- Rossellini

- Nabokov

- Cioran

- Arendt

- Aron

- Marcuse

- Packard

- Wright Mills

- Vian - Queneau

- Quine - Austin

- Blanchot

- Sarraute - Butor - Duras

- Ionesco - Beckett

- Rogers

- Dürrenmatt

- Sutherland - Bacon

- Peake

- Durrell - Murdoch

- Graham Greene

- Kawabata

- Kerouac

- Bellow - Malamud

- Martin-Santos

- Fanon - Memmi

- Riesman

- Böll - Grass

- Baldwin - Ellison

- Bergman

- Tennessee Williams

- Bradbury - A.C.Clarke

- Erikson

- Bachmann - Celan - Sachs

- Rulfo-Paz

- Carpentier

- Achébé - Soyinka

- Pollock

- Mishima

- Salinger - Styron

- Fromm

- Pasternak

- 1960-1970

- 1960s

- Ricoeur

- Roth - Elkin

- Lévi-Strauss

- Burgess

- Pynchon - Heller - Toole

- Ellis

- U.Johnson - C.Wolf

- J.Rechy - H.Selby

- Antonioni

- T.Wolfe - N.Mailer

- Capote - Vonnegut

- Plath

- Burroughs

- Veneziano

- Godard

- Onetti - Sábato

- Sillitoe

- McCarthy - Minsky

- Sagan

- Gadamer

- Martin Luther King

- Laing

- P.K.Dick - Le Guin

- Lefebvre

- Althusser

- Lacan

- Foucault

- Jankélévitch

- Goffman

- Barthes

- Cortázar

- Grossman

- Warhol

- McLuhan

- Soljénitsyne

- Berne

- 1970-1980

- 1980-1990

- 1990-2000

- Lectures XXIe

- Promenades

- Paysages

- Contact

Sciences cognitives & Neurosciences - Jerome Seymour Bruner (1915-2016), George Armitage Miller (1920-2012), "A Study of Thinking" (1956) - Jerry Fodor

(1935-2017), "The Language of Thought" (1975), "The Modularity of Mind" (1983) - Hilary Putnam (1926-2016), "Representation and reality" (1988) - Howard Gardner (1943), "Frames of Mind" (1983) -

Roger W. Sperry (1913-1994), "Science and Moral Priority" (1983) - Thomas Nagel (1937) - David Chalmers (1966), "The Conscious Mind" (1996) - Patricia Smith Churchland (1943), "The

Computational Brain" (1992) - Michael Gazzaniga (1939), "Social Brain" (1987), "Mind Matters" (1988), "Nature's Mind" (1992), "The Consciousness Instinct: Unraveling the Mystery of How the

Brain Makes the Mind" (2018) - .....

Last update: 2018/12/12

Les sciences cognitives couvrent cinq disciplines fondatrices, l'intelligence artificielle, les neurosciences, la psychologie, la philosophie, la linguistique, puis ont envahi progressivement à partir des années 1980 l'ensemble des problématiques de la connaissance. Les sciences cognitives sont des sciences qui se proposent d'étudier la "cognition", c'est-à-dire l'acte de connaître, qui fait appel à plusieurs processus mentaux imbriqués, la perception, la mémoire, le langage, l'intelligence, la conscience, un acte connaître qui nous permet de décrypter l'environnement, de résoudre des problèmes, de raisonner et de décider, d'agir et d'interagir entre humains. Si la psychologie dite cognitive apparaît en 1956, se déploie dans les années 1960-1970 dans la mouvance du fameux modèle cerveau-ordinateur et de l'intelligence artificielle, et c'est au milieu des années 1970 que le terme de "sciences cognitives" s'impose au devant de la scène, au début des années 1980 que les ouvrages se multiplient, enfin à partir des années 2000 que ces sciences, sous l'emprise des neurosciences, recouvrent un vaste domaine sous l'essor des découvertes successives faites autour de l'étude du cerveau.

La philosophie s'interroge depuis toujours sur la nature propre, singulière, de l' "esprit humain", Emmanuel Kant est sans doute un précurseur de la démarche qui s'impose pour aborder ce sujet : le monde que nous percevons n'est pas l'exact reflet de la réalité, mais est fondamentalement une reconstruction. Parallèlement les sciences de la nature se saisissent de la problématique du cerveau, siège de la pensée. Entre 1860 et 1900 sont effectuées les véritables premières découvertes sur le cerveau. Au début du XIXe siècle, la phrénologie de Franz Josef Gall (1758-1828) prétend connaître les instincts et les facultés intellectuelles des hommes en observant la forme de leur crâne. Dans les années 1860, Paul Broca (1824-1880), plus sérieusement, localise le centre du langage dans le lobe temporal gauche. Carl Wernicke (1848-1905) découvre qu`une forme d'aphasie est liée à une lésion d'une zone voisine de l'aire de Broca. Les premières interrogations se posent : le cerveau fonctionne-t-il comme un tout ou y-a-t-il une spécialisation très localisées des facultés mentales? A la fin du XIXe, Santiago Ramón y Cajal (1852-1934) découvre l'existence du neurone. Au début du xx* siècle, Walter Campbell et Korbinian Brodmann établissent les premières cartographies des aires du cerveau. La décennie 1945-1955 est celle de tous les rapprochements dans un contexte technologique en expansion totale, cybernétique, cerveau et ordinateur, l'intelligence artificielle atteint dans les années 1970 une certaine limite dans la possibilité de modéliser la pensée, puis l'ensemble des réflexions bénéficie d'un formidable regain dans le sillage des nouvelles technologies qui se répandent dans les années 1990, scrutant le fonctionnement du cerveau, l'activité cérébrale, in situ (imagerie cérébrale, imagerie à résonance magnétique)....

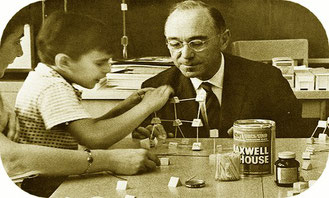

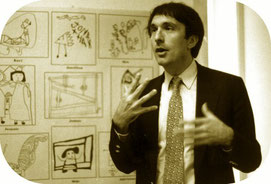

Les débuts de la psychologie cognitive - Au début des années 1950, alors que le béhaviorisme règne dans la psychologie américaine, Jerome Seymour Bruner (1915-2016) et George Armitage Miller (1920-2012). Bruner publient en 1956 "A Study of Thinking", une réflexion qui rompt avec le modèle dominant, ne s'intéresse plus aux seuls comportements observables des sujets (la psychologie behavioriste ne se préoccupe que des conduites observables et non des états mentaux du sujet) mais privilégie les stratégies mentales de sujets confrontés à un problème, à une tâche. George Miller montre, cette même année, dans un article célèbre, "The Magical Number Seven, Plus or Minus Two: Some Limits on Our Capacity for Processing Information", que notre mémoire immédiate est limité (le nombre d'objets pouvant tenir dans la mémoire de travail d'un humain moyen est de 7 plus ou moins 2). Et pour surmonter cette limitation, l'esprit humain emploie une stratégie qui consiste à regrouper les différents éléments. Dans les années 1960, Noam Chomsky et Jerome Bruner initient les termes d'une nouvelle démarche qui se veut pluridisciplinaire (linguistique, anthropologie) et qui entend étudier les productions mentales, les "mystères" de la pensée en action.

Jerry Fodor (1935-2017) publie en 1975 "The Language of Thought", marquant une nouvelle étape dans la construction des sciences cognitives. Il présente un modèle de la pensée qui s'inspire largement de l'analogie avec le fonctionnement de l'ordinateur (the brain is a computer and that thinking is a computational process). Sa fameuse hypothèse, dite LOTH (Language of Thought Hypothesis), postule que toute eprésentation mentale possède une structure linguistique, ou en d'autres termes, que la pensée s'exprime dans un quasi langage mental. Hypothèse contestée par ceux qui privilégient une représentation mentale à base de réseaux connexionnistes ou de cartes et d'images. En 1983, dans "The Modularity of Mind", Fodor postule que l'esprit ne fonctionne pas comme un tout unifié, mais comme une organisation psychologique verticale et modulaire sous-jacente à des comportements biologiquement cohérents. Hypothèse qui suscita nombre de questions, notamment comment peuvent communiquer ou interagir des modules impénétrables sur le plan cognitif? Daniel C. Dennett et Francisco Varela contestèrent ainsi les présupposés d'un certain courant par trop "orthodoxe" du cognitivisme...

Les débats de la "philosophie de l'esprit" & l'IA symbolique - En 1972, Hubert Dreyfus, en publiant "What Machine Can 't Do", conteste les prétentions d'une Intelligence Artificielle qui, portant le projet de modéliser la pensée et de créer des machines dites intelligentes, privilégie une représentation de la pensée humaine en terme d'opérations symboliques abstraites, loin de la véritable nature de notre esprit. Le philosophe John R. Searle poursuit le débat au début des années 1980, affirmant avec son fameux argument de la "chambre chinoise", qu'une machine ne fait que manipuler des symboles abstraits, sans en comprendre la signification. A l'opposé, D.C. Dennett défend résolument l'Intelligence Artificielle, les machines étant susceptibles à terme de relever le défi du sens, qui n'est au fond qu'un problème technique parmi d'autres. La "Philosophy of mind", l'une des branches de la philosophie fortement implantée dans les universités anglo-saxonnes, s'interroge sur la nature des phénomènes mentaux et surtout sur la relation de l'esprit au corps (Mind-Body Problem) et au reste du monde physique, l'une de ses limitations étant sans doute d'être par trop dépendante de l'évolution de l'étude scientifique du cerveau et de son fonctionnement. La démarche des philosophes dits "naturalistes" (Daniel Dennett) est non seulement d'intégrer à la réflexion philosophique les données scientifiques, mais plus encore de ne formuler toute question philosophique qu'en continuité avec les sciences de la nature : c'est ainsi qu'ils aboutissent à la fameuse "théorie de l'identité esprit-cerveau". Jerry Fodor et Hilary Putnam, dans les années 1960, s'opposent à celle-ci et privilégient le concept de "multiréalisabilité cérébrale": un même type d'état mental peut se réaliser dans des structures cérébrales différentes. Hilary Putnam (1926-2016), défenseur du "fonctionnalisme", avec Fodor, assure de plus que le niveau des représentations symboliques est le bon niveau de description de la vie mentale: au fond,l es opérations mentales peuvent se réaliser aussi bien sur un ordinateur que dans un cerveau biologique. Il s'adonnera avec créativité tout au long de ses ouvrages à la problématique des relations entre la perception et la réalité, entre l'esprit et le corps (he Threefold Cord: Mind, Body, and World, 1999).

Le terme de "sciences cognitives" émerge au milieu des années 1970, les voici s'organisant et bénéficiant d'un relais médiatique conséquent via des "modèles", notamment le "paradigme cognitif" de J.Fodor, modèle symbolique ou computo-représentationnel, ou un support financier avec des investissements notamment américains dans un domaine qui semble s'avérer prometteur (MIT, Carnegie Mellon et San Diego). Le premier numéro de la revue Cognitive Science paraît en 1977. Au début des années 1980 se multiplient les manuels et livres de vulgarisation. Howard Gardner (1943), le psychologue célèbre pour sa "theory of multiple intelligences" (Frames of Mind: The Theory of Multiple Intelligences, 1983), s'attache ainsi à nous faire mieux comprendre la révolution intellectuelle des sciences cognitives dans "The Mind's New Science" (1985), affirmant que l'antique opposition corps/pensée est dépassée au profit d'un nouvel objet, le cerveau-esprit. Gardner a montré avec une certaine efficacité qu'il n'existe pas une seule forme d'intelligence mais de multiples intelligences potentielles, que nous en utilisons tous une ou deux pour apprendre le plus efficacement possible, et que notre culture enseigne, renforce et récompense principalement deux types d'intelligence, la verbale/linguistique (Verbal Linguistic) et la logique/mathématique (Logical-mathematical). Selon sa théorie, il existe au moins huit autres types d'intelligence qui sont tout aussi importants, que la plupart des gens "parlent" et qui transcendent les différences culturelles et éducatives: Musical, Spatial, Bodily Kinesthetic (centrée sur le langage corporel), Interpersonal (centrée sur les relations humaines), Intrapersonal (centrée sur sa vie émotionnelle), Naturalist (centrée sur le monde naturel)...

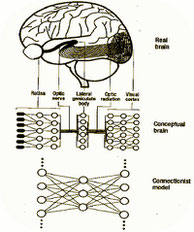

Le "connexionnisme" (Connectionism) - Dans les années 1980, l'intelligence artificielle (IA) classique, dite "symbolique", est fortement contestée, du moins dans ses velléités de modélisation de la pensée, d'une intelligence vue comme un modèle symbolique (les impacts positifs au travers des systèmes experts, robotique ou objets intelligents sont indéniables). Paraît un modèle concurrent, le "connexionnisme", modèle en réseau s'inspirant du fonctionnement du cerveau: la neurobiologie, pertinente pour une explication précise des processus mentaux, est à l'origine des concepts de base des réseaux neuronaux. Les opérations cognitives résulteraient du fonctionnement de petites unités interconnectées qui interagissent entre elles, sans pilotage central, et munies de poids qui mesurent la force des connexions entre les unités. Ces poids modélisent les effets des synapses qui relient un neurone à un autre. Des expériences sur des modèles de ce genre ont démontré la capacité d'apprendre des compétences telles que l'apprentissage et la reconnaissance des formes, la lecture et la détection d'une structure grammaticale simple. (David Rumelhart,James McClelland, Parallel Distributed Processing: Explorations in the Microstructure of Cognition, 1986). Si la question de reconnaître une pertinence au paradigme connectionniste (connectionist paradigm) dans des domaines tels que, par exemple, la sphère de nos comportements dans la vie ordinaire (Folk Psychology), la fixation du sens eu égard à l'activation de nos états cérébraux (Semantic), fait toujours l'objet de vifs débats, il suggère fortement une explication biologique des phénomènes cognitifs...

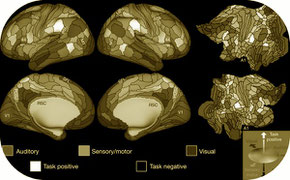

Le rapprochement, la mise en correspondance entre anatomie et physiologie du cerveau, d'une part, psychologie des fonctions mentales, d'autre part, s'effectue progressivement au rythme des travaux menés en neurobiologie tout au long du XXe siècle. Après la mise en évidence du fonctionnement des neurones, de la transmission de l'influx nerveux, du rôle des synapses, de l'action des neuromédiateurs, de la cartographie des fonctions cérébrales par Wilder Penfield (1950), le strict domaine de la neurobiologie est franchi dans les années 1980 avec les travaux de David Hunter Hubel et Torsten Wiesel portant sur les différentes aires visuelles impliquées dans la vision (l'étude du trajet de l'influx nerveux depuis l'œil jusqu'au cortex visuel leur permet de distinguer de nombreuses particularités structurelles et fonctionnelles de cette région du cerveau), et ceux du neurologue Roger W. Sperry (1913-1994), qui a mis en lumière le rôle spécifique des deux hémisphères cérébraux : "Pendant plusieurs décades, on a supposé que le cerveau humain évoluait de telle sorte que le côté gauche dominait totalement le droit. Associé au langage mais aussi aux facultés cognitives supérieures qui en dépendent, il déterminerait également les capacités abstraites, mathématiques, logiques, et autres pouvoirs de raisonnement.... Il est désormais tout à fait acquis que des fonctions mentales supérieures siègent bel et bien dans l’hémisphère mineur. Tout ce que nous avons observé au cours de longues années d’étude confirme que l’hémisphère muet possède une expérience consciente intérieure du même ordre que celle de l’hémisphère parlant mais qualitativement différente. L’hémisphère droit perçoit, pense, apprend et se souvient, d’une façon très humaine. Il raisonne aussi d’une manière non verbale, prend des décisions réfléchies et détermine des actions volontaires et originales ainsi que des mouvements appris complexes. De surcroît, il fournit des réponses émotionnelles humaines typiques quand il se trouve confronté à des stimulations chargées d’affectivité..."

Au début des années 1990, convergent sciences cognitives et étude des stratégies mentales, intérêt grandissant pour un "objet" particulièrement ambigu, la "conscience", et progrès extraordinaires des nouvelles techniques d`imagerie cérébrale qui transforment radicalement l'étude du cerveau et de son activité. La vague des "neurosciences" s'impose à partir des années 2000, la compréhension des opérations mentales devient un formidable enjeu qui envahit toutes les disciplines en ne privilégiant aucun modèle spécifique, la science cognitive perdant ainsi quelque part son identité propre. Les sciences dites cognitives tentent de décrire les processus psychologiques (la perception, la mémoire, le langage, la conscience) à partir des données neurobiologiques (le système nerveux central, son anatomie, sa physiologie, son fonctionnement), et intègrent dans leurs préoccupations des phénomènes réputés non cognitifs, comme les émotions : comment le cortex pourrait-il fonctionner sans le recours aux régions limbiques du cerveau? La grande découverte de la "plasticité" du cerveau (la capacité du cerveau à se remodeler en fonction de l'activité humaine) modifie fondamentalement des approches, jusque-là opposées, un cognitif issu des capacités mentales et privilégiant la structure du cerveau, un cerveau façonné par l'expérience et stimulé par le social. Mais plus encore, voici apparaître un "inconscient cognitif" et les approches psychanalytiques forgées par Freud ou Jung réinterprétées à la lumière de ce changement de référentiel.

Les neurosciences s'efforcent non seulement de cartographier le cerveau au travail, mais de définir les opérations mentales impliquées. L'lRM ainsi permet d'isoler et d'observer les différentes composantes cognitives d'une action ou d'une tâche, leurs spécificités et leurs articulations, contribuant à expliciter certaines fonctions psychologiques. On sait que s'il existe des zones spécialisées dans le traitement de la vision, du langage, de la motricité, localisables avec précision, on sait aussi que chaque fonction complexe (la lecture, le langage), implique plusieurs zones à la fois. On a pu mettre en évidence, par exemple, deux zones cérébrales distinctes, et donc deux fonctions psychologiques, dans un processus mental des mathématiques, qui consiste à calculer un nombre précis ou à effectuer une approximation sur ce résultat.

Dès les années 1960, la philosophie de l'esprit s'est rétractée autour de quelques personnalités, Gilbert Ryle (1900-1976), Willard Van Orman Quine (1908-2000), et la philosophie en elle-même amorçait un déclin progressif. Les neurosciences ont par suite réveillé nombre de domaines. Elles se sont emparées progressivement, directement ou indirectement, de toutes les questions fondamentales que nous nous posons tant sur notre existence propre, individuelle ou sociale, que celles que pouvaient traiter jusque-là la seule philosophie, voire la métaphysique : le problème de l'âme et du corps (mind body problem), le problème de la rationalité, qui suppose que la pensée est réductible à un modèle symbolique de l'esprit, le problème de l'intentionnalité, concept central de la phénoménologie qui s'interroge sur la signification des objets mentaux.

Le statut de la conscience est au centre des mille théories et paradoxes qui alimentent le champ du "mind body problem". Quelle différence peut-on faire, penser, entre nos états mentaux et la réalité physiologique de notre cerveau? L'esprit fonctionne-t-il comme un ordinateur inconscient à lui-même? Les philosophes dans la mouvance de ces théories multiplient des "expériences de pensée" qui servent à formaliser telle ou telle problématique. Alan Turing en fournit l'exemple type, ici point d'argumentation ou de raisonnement sans fin, mais un "test" organisé autour d'une machine qui participe à un jeu de l'imitation avec l'intelligence humaine vis-à-vis d'un observateur qui ignore tout du dispositif (Computing Machinery and intelligence, 1950). L'expérience de la "chambre chinoise" formulée par John R.Searle est un classique du genre (Minds, Brains and Programs, 1980). Ludwig Wittgenstein (1889-1951) via sa métaphore "Beetle in a Box" (1953) entend montrer que nous sommes dans l'incapacité d'être quelqu'un d'autre, de penser ce que peut penser l'autre. Thomas Nagel entend, par un identique procédé, montrer qu'il est vain d'espérer théoriser sur ce qu'est la subjectivité dans son célèbre article, "Quel effet cela fait-il d'être une chauve-souris" (What is it like to be a bat?, 1974).

David Chalmers (1966) dans "The Conscious Mind: In Search of a Fundamental Theory" (1996), relie deux constats qui interrroge l'observateur de la réalité que nous sommes : "What is the place of consciousness in nature?" et "What is the reality behind quantum mechanics?". Des physiciens comme John von Neumann, Eugene Wigner et beaucoup d'autres "interprètes" de la mécanique quantique ont soutenus que l'effondrement de la fonction ondulatoire est la preuve d'une conscience ou d'un esprit cosmique de Dieu à l'œuvre pour créer l'univers. La conscience est-elle une composante fondamentale et non matérielle de l'univers? Chalmers décrit sa position comme un dualisme naturaliste (naturalistic dualism), il doute tout simplement que la conscience puisse être expliquée par des théories physiques, parce que la conscience elle-même n'est pas physique. "information (in the actual world) has two aspects, a physical and a phenomenal aspect". Dualisme donc parce que nous aurions une relation entre l'idéalisme (les idées sont des informations immatérielles) et le matérialisme (l'idée que tout dans l'univers est matière).

"The treatment of information brings out a crucial link between the physical and the phenomenal: whenever we find an information space realized phenomenally, we find the same information space realized physically...It is natural to suppose that this double life of information spaces corresponds to a duality at a deep level. We might even suggest that this double realization is the key to the fundamental connection between physical processes and conscious experience." (Le traitement de l'information fait ressortir un lien crucial entre le physique et le phénoménal : chaque fois que l'on trouve un espace d'information réalisé phénoménalement, on retrouve le même espace d'information réalisé physiquement... Il est naturel de supposer que cette double vie des espaces d'information correspond à une dualité à un niveau profond. Nous pourrions même suggérer que cette double réalisation est la clé du lien fondamental entre les processus physiques et l'expérience consciente.)

"I resisted mind-body dualism for a long time, but I have now come to the point where I accept it, not just as the only tenable view but as a satisfying view in its own right. It is always possible that I am confused, or that there is a new and radical possibility that I have overlooked; but I can comfortably say that I think dualism is very likely true. I have also raised the possibility of a kind of panpsychism. Like mind-body dualism, this is initially counterintuitive, but the counterintuitiveness disappears with time. I am unsure whether the view is true or false, but it is at least intellectually appealing, and on reflection it is not too crazy to be acceptable." (J'ai longtemps résisté au dualisme corps-esprit, mais j'en suis maintenant arrivé au point où je l'accepte, non seulement comme le seul point de vue défendable, mais comme un point de vue satisfaisant en soi).

Patricia Smith Churchland (1943) a quant à elle proposé via deux ouvrages, "Neurophilosophy" (1986) et "The Computational Brain" (1992, avec T. J.Sejnowski), un modèle neuronal-computationnel qui tente de combler le fossé entre les niveaux inférieurs et supérieurs de l'organisation du cerveau. Ses travaux visent à prendre en compte les développements scientifiques sur notre compréhension de la conscience, du moi, du libre arbitre, de la prise de décision, et de leur base neurobiologique. "I am what I am because my brain is as it is", et comme souvent pour les chercheurs américains, toutes les questions convergent à un moment ou à un autre vers celle de l'éthique, de la morale, du soi et des relations inter-personnelles (Braintrust: What Neuroscience Tells Us about Morality, 2011)...

Reste encore et toujours le mystère de l'esprit humain, une sorte d'entité non physique abstraite qui est néanmoins capable d'exercer une causalité descendante sur le monde physique : "The brain is determined, but the person is free" - Le neurospsychologue Michael Gazzaniga (1939), étudiant l'asymétrie des deux hémisphères (studies of "split-brain" patients), a ainsi préciser leur complémentarité : un hémisphère droit, en charge du champ visuel gauche et des signaux somatosensoriels du côté gauche du corps, qui ne transmettrait pas ses informations à l'hémisphère gauche, en charge de le interpréter et de les "rationaliser", n'mpêche pas celui-ci de fonctionner, de les traiter au niveau du langage; l'esprit n'a pas conscience de l'information qu'il ne reçoit pas, et pourtant génère de la raison et de l'explication sur ses actions. "L’hémisphère cérébral gauche a tendance à fabriquer des récits qui ne s’accorde pas nécessairement avec la vérité", confirmera Antonio Damasio (Le sentiment même de soi, 1999). Michael Gazzaniga étendra son sujet à la question du libre-arbitre (The Ethical Brain, 2005), hanté par la question de la responsabilité morale, compensant paradoxalement un certain déterminisme de notre cerveau par l'indéterminisme de nos interactions sociales.

"The logic goes like this: The brain determines the mind, and the brain is a physical entity, subject to ail the rules of the physical world. The physical world is determined, so our brains must also be determined. If our brains are determined, and the brain is the necessary and sufficient organ that enables the mind, we are then left with these questions: Are the thoughts that arise from our mind also determined? Is the free will we seem to experience just an illusion? And if free will is an illusion, must we revise our concepts of what it means to be personally responsible for our actions? " (Le cerveau détermine l'esprit, et le cerveau est une entité physique, soumise à toutes les règles du monde physique. Le monde physique est déterminé, donc notre cerveau doit aussi être déterminé. Si notre cerveau est déterminé et que le cerveau est l'organe nécessaire et suffisant qui permet à l'esprit de fonctionner, les pensées qui surgissent de notre esprit sont-elles également déterminées ? Le libre arbitre que nous semblons éprouver n'est-il qu'une illusion ?)

"Neuroscience [also] tells us that by the time any of us consciously experience something, the brain has already done its work. When we become consciously aware of making a decision, the brain has already made it happen. This raises the question, Are we out of the loop? It is one thing to worry about diminished responsibility due to insanity or brain disease, but now the normal person appears to be on the deterministic book as well. Should we abandon the concept of personal responsibility? I don't think so. We need to distinguish among brains, minds, and personhood. People are free and therefore responsible for their actions; brains are not responsible" (Les neurosciences[aussi] nous disent qu'au moment où chacun d'entre nous ressent consciemment quelque chose, le cerveau a déjà fait son travail. Lorsque nous prenons conscience de prendre une décision, le cerveau l'a déjà prise. Cela soulève la question suivante : sommes-nous hors du circuit ? C'est une chose de s'inquiéter de la diminution de la responsabilité due à la folie ou à une maladie du cerveau, mais maintenant, la personne normale semble aussi faire partie du livre déterministe. Devrions-nous abandonner le concept de responsabilité personnelle ? Je ne crois pas, non. Nous devons distinguer les cerveaux, les esprits et les personnes. Les gens sont libres et donc responsables de leurs actes ; le cerveau n'est pas responsable).

Les neurosciences cognitives et computationnelles (Cognitive and computational neuroscience) ne cessent de s'étendre aux questions traditionnellement abordées par la Philosophie et les Sciences humaines et sociales, notamment la nature de la conscience, de l'action, des connaissances et de la normativité, des relations entre individus. Les découvertes qui seront effectuées sur la structure et le fonctionnement du cerveau animeront bien des spéculations à venir, et il semble désormais improbable d'ouvrir tout débat sur notre humaine nature et nos possibilités de penser, de ressentir, d'agir ou d'inter-agir en ignorant les recherches en cours relatives à notre activité cérébrale.... Reste qu'un regard d'épistémologue sur les neurosciences cognitives nous permettrait de clarifier et de solidifier une démarche cruciale pour les années à venir…

"The Consciousness Instinct: Unraveling the Mystery of How the Brain Makes the Mind" (2018)Michael S. Gazzaniga

How matter makes minds ? - « The father of cognitive neuroscience » éclaire le passé, le présent et l’avenir du problème cerveau-esprit. Comment les neurones se transforment-ils en esprits? Comment les « choses » physiques – les atomes, les molécules, les produits chimiques et les cellules – créent-elles des mondes vivants et variés à l’intérieur de notre boîte cranienne ? Et le problème de la conscience nous ronge depuis des millénaires. Au siècle dernier, il y a eu des percées massives qui ont réécrit la science du cerveau, et pourtant les énigmes auxquelles font face les Grecs anciens sont toujours bien présentes : tournons-nous en rond, en vain? Mais Michael S. Gazzaniga persiste à rassembler encore et toujours les dernières recherches en la matière, persiste à répéter que si nos cerveaux fabriquent des machines, on ne peut pas les réduire à celles-ci : et on ne peut se résoudre à ne pas tenter, une fois de plus, à présenter une nouvelle façon de conceptualiser la conscience ...

"Plainly stated, I believe consciousness is an instinct. Many organisms, not just humans, come with it, ready-made. That is what instincts are, something organisms come with. Living things have an organization that allows life and ultimately consciousness to exist, even though they are made from the same materials as the non-living natural world that surrounds them. And instincts envelop organisms from bacteria to humans. Survival, sex, resilience, and walking are commonly thought to be instincts, but so, too, are more complex capacities such as language and sociality—all are instincts. The list is long,and we humans seem to have more instincts than other creatures. Yet there is something special about the consciousness instinct. It is no ordinary instinct. In fact, it seems so extraordinary that many think only we humans can lay claim to it. Even if that’s not the case, we want to know more about it. Andbecause we all have it, we all think we have insight into it. As we will see, it is a slippery, complex instinct situated in the universe’s most impenetrable organ, the brain..."

"En clair, je crois que la conscience est un instinct. De nombreux organismes, et pas seulement les humains, sont dotés de cet instinct, prêt à l'emploi. C'est ce que sont les instincts, quelque chose que les organismes possèdent déjà. Les êtres vivants ont une organisation qui permet à la vie et finalement à la conscience d'exister, même s'ils sont faits des mêmes matériaux que le monde naturel non vivant qui les entoure. Les instincts enveloppent les organismes, de la bactérie à l'homme. La survie, le sexe, la résilience et la marche sont généralement considérés comme des instincts, mais il en va de même pour des capacités plus complexes telles que le langage et la socialisation - tous sont des instincts. La liste est longue, et nous, les humains, semblons avoir plus d'instincts que les autres créatures. Pourtant, l'instinct de conscience a quelque chose de particulier. Ce n'est pas un instinct ordinaire. En fait, il semble si extraordinaire que beaucoup pensent que seuls les humains peuvent y prétendre. Même si ce n'est pas le cas, nous voulons en savoir plus. Et parce que nous l'avons tous, nous pensons tous en avoir une idée. Comme nous le verrons, il s'agit d'un instinct glissant et complexe situé dans l'organe le plus impénétrable de l'univers, le cerveau..."

"Complex instincts are more like democracies; they are identifiable but not easily localized. They emerge from the interaction of simple instincts but are not those things themselves—just as an intricate pocket watch chugs away at keeping time, yet time itself is impossible to find in the watch. In order to understand how the watch relates to time, you have to describe its principles of design, its architecture, not just list all its springs and gears. The same is true of the consciousness instinct. Don’t think that if consciousness is an instinct, there will be a single, unitary, discrete brain network generating that phenomenal self-aware state we all relish. It is not like that at all. When we visit the neurologic wards, armed with our ideas, you’ll recognize right away that patients who suffer from dementia, even severe dementias, are conscious. These patients with widely distributed brain lesions, a level of disruption vast enough to bring any computing machine to its knees, remain conscious. In one hospital room after another, each harboring a patient with a focal or a diffuse brain impairment, consciousness purrs along. After a tour of the wards, it begins to look like consciousness is not a system property at all. It is a property of local brain circuits."

"Les instincts complexes ressemblent davantage à des démocraties ; ils sont identifiables mais difficilement localisables. Ils émergent de l'interaction d'instincts simples, mais ne sont pas eux-mêmes ces instincts - tout comme une montre de poche complexe qui s'efforce de donner l'heure, alors que l'heure elle-même est impossible à trouver dans la montre. Pour comprendre comment la montre est liée au temps, il faut décrire ses principes de conception, son architecture, et non se contenter d'énumérer tous ses ressorts et ses engrenages. Il en va de même pour l'instinct de conscience. Ne pensez pas que si la conscience est un instinct, il y aura un réseau cérébral unique, unitaire et discret générant cet état phénoménal de conscience de soi que nous apprécions tous. Ce n'est pas du tout le cas. Lorsque nous visiterons les services de neurologie, armés de nos idées, vous constaterez immédiatement que les patients souffrant de démence, même sévère, sont conscients. Ces patients atteints de lésions cérébrales largement réparties, d'un niveau de perturbation suffisamment important pour mettre à genoux n'importe quelle machine informatique, restent conscients. Dans une chambre d'hôpital après l'autre, chacune abritant un patient atteint d'une déficience cérébrale focale ou diffuse, la conscience ronronne. Après avoir fait le tour des salles, il semble que la conscience ne soit pas du tout une propriété du système. C'est une propriété des circuits cérébraux locaux...."

Dans la première partie de ce livre, Gazzaniga nous montre comment la nature est devenue une chose distincte de nous qui peut être étudiée et comprise en termes objectifs. Nous retraçons cette idée de Descartes aux temps modernes et à l’aube de la biologie moderne. Étonnamment, la plupart des pensées scientifiques modernes ont fait un retour en arrière pour reprendre les idées des anciens Grecs, et aboutissent aux mêmes modèles, liant le mental et le physique dans un système. La science moderne a commencé à poursuivre le même but que la pensée grecque, mais jusqu’à présent, le succès n'est pas probant. Encore une fois, de nouvelles idées sont nécessaires ...

Dans la deuxième parties de cet ouvrage, certains principes modernes du fonctionnement du cerveau sont introduits : ils sont nécessaires au voyage que nous entreprenons, et notamment pour comprendre la façon avec laquelle les neurones produisent de l'esprit. Il est étonnant de voir comment la métaphore du « cerveau comme machine » (brain as a machine), proposée pour la première fois par Descartes et entièrement adoptée par la plupart des sciences modernes, nous a amenés à croire que la machine entière est nécessaire pour remplir bon nombre de ses fonctions. En fait, nous sommes chacun une sorte de confédération de modules plutôt indépendants, orchestrés pour travailler ensemble (we are each a confederation of rather independent modules, orchestrated to work together). Pour comprendre comment ces modules collaborent, nous devons connaître l’architecture globale du système, une architecture appelée « superposition » (layering) qui sera familière à de nombreux lecteurs, comme les informaticiens... Enfin, l'auteur nous invite ici à rendre à la clinique neurologique pour tester cette approche. Nous y découvrirons que notre cerveau modulaire, avec son architecture en couches, gère notre conscience à partir de... partout dans ses tissus locaux, encore et encore. Il n'y a pas un système centralisé qui produit la grande magie de l'expérience consciente. Elle est partout, et il semble impossible de l'éradiquer, même avec une maladie cérébrale de grande ampleur comme la maladie d'Alzheimer... (And finally, we’ll pay that visit to the neurologic clinic to test this formulation. There we will discover that our modular brain with its layered architecture is managing our consciousness from … everywhere in its local tissues, over and over again. There is not one centralized system working to produce the grand magic of conscious experience. It is everywhere, and you can’t seem to stamp it out, not even with a wide-ranging brain disease like Alzheimer’s).

Dans la troisième partie est abordée la question lancinante au cœur de cette grande affaire d'esprit/cerveau : Comment les neurones font-ils naître l'esprit ? Comment ces faisceaux de tissus humides nous rendent-ils, vous et moi, "mentaux" (How do those squishy bundles of wet tissue make you and me mental) ? Il s'avère qu'il existe des lacunes dans notre compréhension du monde physique. Nous étudions un niveau d'organisation puis un autre, mais en fait nous ne comprenons pas comment ces deux niveaux différents fonctionnent ensemble. Il existe un fossé notoire entre la vie et la matière inanimée, entre l'esprit et le cerveau, entre le monde quantique et notre monde quotidien. Comment combler ce fossé ? Il me semble que la physique peut nous aider. (There is a notorious gap between life and inanimate matter, between mind and brain, between the quantum world and our everyday world. How can those gaps be closed? It looks to me like physics can help us).

Enfin, Gazzaniga en vient à proposer une perspective sur la façon dont les modules, les couches et les lacunes jouent pour produire ce que nous appelons l'expérience consciente (Finally, I offer a perspective on how the modules, layers, and gaps play out to yield what we call conscious experience). Le professeur de psychologie Richard Aslin m'a dit un jour qu'il pensait que l'idée de "conscience" était une approximation pour toute une série de variables liées à notre vie mentale.

Nous utilisons la "conscience" (consciousness) comme un raccourci pour décrire facilement les fonctions d'une multitude de mécanismes innés et instinctifs tels que le langage, la perception et l'émotion. Il devient évident que la conscience est mieux comprise en tant qu' "instinct complexe" (It becomes evident that consciousness is best understood as a complex instinct as well). Nous sommes tous dotés d'une multitude d'instincts. Notre schéma de pensée saute sans arrêt d'un côté à l'autre. Nous éprouvons des sentiments à l'égard d'une idée, puis de son contraire, puis de notre famille, puis d'une démangeaison, puis d'une musique préférée, puis de la réunion à venir, puis de la liste des courses, puis du collègue irritant, puis des Red Sox, puis... Cela continue jusqu'à ce que nous apprenions, presque contre notre gré, à avoir une pensée linéaire ( a linear thought) ...."